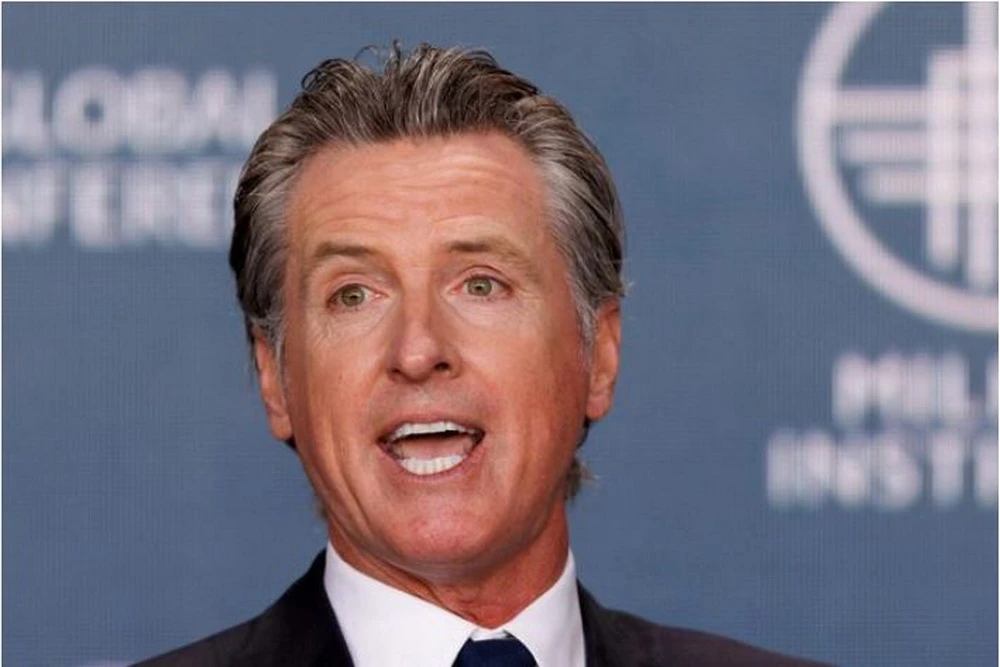

Ngày 29/9, Thống đốc bang California Gavin Newsom đã ký 2 dự luật nhằm bảo vệ trẻ vị thành niên khỏi tình trạng lạm dụng các công cụ trí tuệ nhân tạo (AI) tạo ra hình ảnh khiêu dâm có hại cho trẻ.

Các biện pháp này là một phần trong nỗ lực chung của California nhằm tăng cường các quy định liên quan đến AI, vốn đang ngày càng ảnh hưởng đến cuộc sống của người dân Mỹ, nhưng lại ít hoặc không có sự giám sát của pháp luật.

Các luật mới, nhận được sự ủng hộ mạnh mẽ của cả hai đảng Dân chủ và Cộng hòa, đã lấp lỗ hổng pháp lý, siết chặt việc giải quyết các hình ảnh lạm dụng tình dục trẻ em do AI tạo ra.

Luật hiện hành không cho phép công tố viên truy tố những người sở hữu hoặc phát tán hình ảnh lạm dụng tình dục trẻ em do AI tạo ra nếu họ không thể chứng minh các hình ảnh đó mô tả người thật. Tuy nhiên, luật mới quy định hành vi như vậy đủ điều kiện cấu thành trọng tội.

Deepfake là phương thức sử dụng AI tạo ra các sản phẩm công nghệ giả (fake) dưới dạng âm thanh, hình ảnh hoặc thậm chí là cả video.

Vấn đề deepfake không phải là mới, song lại đang trở nên tồi tệ hơn khi công nghệ sản xuất dễ tiếp cận và dễ sử dụng hơn.

Trong vài năm qua, các nhà nghiên cứu đã gióng lên hồi chuông cảnh báo về sự bùng nổ các nội dung lạm dụng tình dục trẻ em do AI tạo ra thông qua việc sử dụng hình ảnh thực của nạn nhân hoặc nhân vật ảo./.

Một số cách để tránh bị lừa bởi công nghệ deepfake do AI tạo ra

Rất nhiều bức ảnh được tạo ra bằng deepfake đã sử dụng ánh sáng điện tử, giống như một loại hiệu ứng làm mịn da và khiến cho làn da của người trong ảnh trở nên cực kỳ bóng bẩy.