Ảnh minh họa. (Nguồn: Getty Images)

Ảnh minh họa. (Nguồn: Getty Images) Ghi nhận từ dự án Chống lừa đảo của Cục An toàn thông tin, Bộ Thông tin và Truyền thông, 3 tháng đầu năm 2023, hệ thống đã phát hiện hơn 3.200 trang website lừa đảo người dùng Việt Nam.

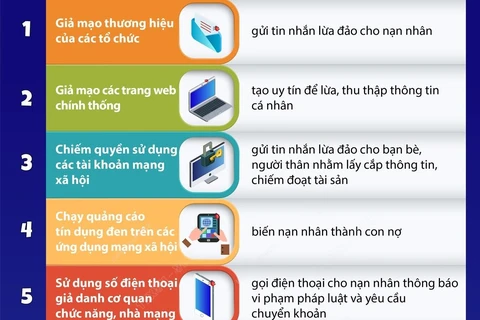

Chuyên gia an ninh mạng cảnh báo: các hình thức lừa đảo trên mạng liên tục gia tăng không ngừng, với nhiều thủ đoạn tinh vi nhờ sự hỗ trợ của công nghệ cao. Người dân cần cẩn trọng, kiểm chứng thông tin, trang bị thông tin, kỹ năng an toàn thông tin, tỉnh táo và kịp thời dừng lại để không trở thành nạn nhân của lừa đảo trên không gian mạng.

Lừa đảo bằng công nghệ Deepfake

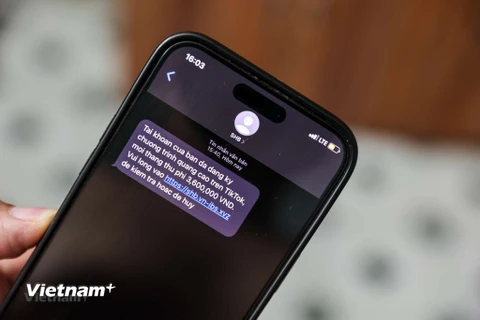

Tháng 4/2023, anh Đặng Anh Quang (quận Hai Bà Trưng, Hà Nội) bất ngờ nhận được lời nhờ chuyển tiền từ một tài khoản Zalo của người bạn thân. Ngay sau đó, người bạn này đã gọi điện thoại có hình ảnh (video call) cho anh Quang để yêu cầu, thúc giục chuyển tiền gấp.

Khi nhìn thấy hình ảnh, nghe giọng nói giống bạn của mình, anh Quang đã chuyển 20 triệu đồng đến tài khoản được cung cấp trong Zalo.

Sau đó, anh Quang mới biết mình đã bị kẻ lừa đảo dùng công nghệ Deepfake để thực hiện cuộc gọi có hình ảnh và thành công lừa được tiền.

Anh Đặng Anh Quang cho biết: "Khi trao đổi bằng video call, tôi thấy đúng mặt bạn tôi, nhưng hình ảnh khá mờ và môi mấp máy nói được vài từ sau đó cuộc gọi bị gián đoạn. Tôi nghĩ mạng Internet kém, nhưng rõ ràng đó làm khuôn mặt của bạn tôi nên đã tin tưởng gửi tiền."

[Cảnh báo các hình thức lừa đảo phổ biến trên không gian mạng]

Cũng gặp trường hợp giống anh Quân, chị Ngô Hồng Tú (quận Thanh Xuân, Hà Nội) nhận được cuộc gọi video với hình ảnh giống một người bạn, nhờ chuyển khoản 30 triệu để xử lý việc gấp.

Nhờ có tài khoản trước đó của người bạn này, chị Tú đã chuyển khoản vào tên chính chủ. Sau khi người bạn gọi điện lại hỏi vì sao lại chuyển tiền, chị Tú mới thấy mình quá may mắn, dù đã sập bẫy lừa đảo nhưng lại chuyển đúng vào tài khoản người thân nên không bị mất tiền.

Trong hai trường hợp trên, người dùng đã bị tội phạm mạng sử dụng công nghệ Deepfake để thực hiện cuộc gọi lừa đảo.

Theo Hãng bảo mật Kaspersky, Deepfake là một từ ghép của "deep" trong "deep-learning" (học sâu) và "fake" (giả mạo). Deep-learning nhờ ứng dụng trí tuệ nhân tạo (AI) vào nhiều thuật toán nhằm tổng hợp dần các tính năng cao cấp từ dữ liệu đầu vào và có khả năng học hỏi từ những dữ liệu để tạo khuôn mặt con người, chuyển động vật lý và giọng nói…

Nhờ đó, công nghệ Deepfake đã tạo ra các sản phẩm công nghệ video có âm thanh, hình ảnh làm giả đối tượng ngoài đời thực với độ chính xác khá cao.

Video giả mạo sẽ càng giống thật khi công nghệ thu thập được càng nhiều dữ liệu về hình dạng, giọng nói của người dùng mạng xã hội.

Tiến sỹ Đinh Viết Sang, Phó Giám đốc Trung tâm Nghiên cứu quốc tế về trí tuệ nhân tạo, Đại học Bách Khoa Hà Nội, khẳng định việc đăng tải hình ảnh, video của cá nhân hoặc người thân lên mạng xã hội là nguồn thông tin đầu vào để kẻ xấu lợi dụng, nhằm tạo ra những video, hình ảnh giả thực hiện hành vi lừa đảo.

Chia sẻ về kịch bản lừa đảo diễn ra trên không giang mạng bằng cách sử dụng công nghệ cao, chuyên gia an ninh mạng Vũ Thanh Thắng (Công ty an ninh mạng thông minh SCS - Smart Cyber Security) cho biết kẻ lừa đảo tìm cách chiếm đoạt tài khoản mạng xã hội của người dùng, như: Zalo, Facebook...; rồi từ những hình ảnh, video được chính người dùng đăng tải, tiếp đó thu thập thông tin cá nhân, dùng công nghệ Deepfake tạo ra đoạn video mạo danh, kẻ lừa đảo nhắn tin liên quan đến mượn tiền, nhờ thanh toán, chuyển khoản… đến những người dùng trong danh sách bạn bè (trên Zalo, Facebook…) của nạn nhân. Đồng thời, cuộc gọi video mạo danh được thực hiện thông qua việc phát video giả mạo để tăng độ tin cậy nhằm lừa đảo thành công hơn.

Những cuộc gọi video giả mạo này thường chỉ vài giây với hình ảnh, âm thanh không sắc nét để người nhận chỉ có thể nhìn thoáng qua. Sau đó, các cuộc gọi sẽ bị ngắt quãng với lý do sóng điện thoại kém. Mấu chốt của cuộc gọi lừa đảo là để nạn nhân tin rằng bạn bè, người thân của mình đang gặp vấn đề, cần giúp đỡ, gửi tiền gấp. Đây là thủ đoạn lừa đảo mới, rất tinh vi đang có xu thế trở nên phổ biến.

Ông Vũ Ngọc Sơn, Giám đốc công nghệ Công ty Aen ninh mạng NCS, cho biết các chiêu trò, hình thức lừa đảo gần đây đều không phải mới nhưng các đối tượng lừa đảo đã ứng dụng công nghệ tiên tiến hiện đại; từ đó, khả năng thành công của các chiêu lừa đảo sẽ cao hơn và ngày càng khó lường với người dùng Internet.

Với sự phát triển của trí tuệ nhân tạo (AI), các ứng dụng kiểu như Deepfake sẽ giúp một người bình thường, không cần giỏi về công nghệ hay xử lý đồ họa cũng có thể dễ dàng thực hiện được việc ghép ảnh, ghép video, thậm chí là cả giọng nói.

Chuyên gia Vũ Ngọc Sơn cảnh báo, tình trạng lừa đảo bằng Deepfake có thể sẽ bùng phát trong thời gian tới, bởi số tiền các đối tượng chiếm được qua mỗi vụ việc là khá lớn trong khi công sức bỏ ra không nhiều.

Tránh sập bẫy lừa đảo

Trên không gian mạng, nhiều đối tượng lừa đảo nhằm đến người dùng bởi đây là khâu yếu nhất trong chuỗi mắt xích đảm bảo an toàn thông tin.

Đại dịch COVID-19 đã khiến gia tăng số lượng những người dùng Internet, đặc biệt nhóm người già, trẻ em gia tăng đáng kể. Đây cũng là những nhóm đối tượng không có nhiều kỹ năng bảo vệ thông tin cá nhân trên môi trường mạng Internet.

Ảnh minh họa. (Nguồn: Tylertech)

Ảnh minh họa. (Nguồn: Tylertech) Ông Trương Đức Lượng, Chủ tịch Công ty Cổ phần An ninh mạng Việt Nam VSEC, cho rằng nâng cao nhận thức về đảm bảo an toàn khi tham gia môi trường mạng vẫn là biện pháp hiệu quả với chi phí tối ưu. Việc này nên được làm thường xuyên, đa dạng cách thể hiện, chia nhỏ theo chủ đề, đối tượng để cộng đồng có thể thường xuyên nhận thông điệp, ghi nhớ thuận tiện hơn.

Chuyên gia Ngô Minh Hiếu, Trung tâm Giám sát an toàn không gian mạng quốc gia-NSCS (Cục An toàn thông tin, Bộ Thông tin và Truyền thông), cho rằng để tránh bị lừa, tốt nhất người dân nên tỉnh táo trong mọi tình huống. Khi nhận được yêu cầu chuyển tiền cần bình tĩnh, kiểm chứng thông tin và xác thực nguồn tin bằng cách chủ động gọi điện thoại trực tiếp với thời gian dài hơn một phút với nhiều câu hỏi khác nhau để xác thực thông tin bởi hiện tại, Deepfake chưa thể giả mạo được một cuộc trò chuyện trong thời gian thực. Đồng thời, cảm xúc hay biểu cảm của hình ảnh do trí tuệ nhân tạo tạo ra bằng Deepfake chưa thể bắt chước được người thật.

Chia sẻ về việc giữ an toàn cho bản thân trước nguy cơ Deepfake, bà Võ Dương Tú Diễm, Giám đốc khu vực Việt Nam, Campuchia và Myanmar của Công ty an ninh mạng toàn cầu Kaspersky, nhấn mạnh đầu tiên người dùng tránh để tài khoản của bản thân trở thành mục tiêu cho hacker nhắm đến. Bên cạnh việc sao lưu thường xuyên, người dùng cần sử dụng mật khẩu mạnh và khác nhau cho các tài khoản cá nhân để tránh bị đánh cắp. Ở cấp độ doanh nghiệp, tổ chức, cần đảm bảo các nhân viên, thành viên được thông tin về cách công nghệ Deepfake hoạt động và nguy cơ tiềm ẩn rủi ro lừa đảo.

Điều quan trọng, mọi người cần xây dựng một thái độ “hoài nghi” đối với tin nhắn thoại và video call. Điều này có thể không hoàn toàn đảm bảo bạn được an toàn khỏi các trò lừa đảo, nhưng nó có thể giúp tránh được nhiều cạm bẫy.

Trung tá Triệu Mạnh Tùng, Phó cục trưởng Cục An ninh mạng và phòng chống tội phạm sử dụng công nghệ cao (Bộ Công an), khuyến cáo người dân khi được yêu cầu chuyển tiền, nên kiểm tra thông tin qua các kênh liên lạc chính thống trước khi thực hiện giao dịch tài chính, tránh trở thành nạn nhân của các vụ lừa đảo.

Trung tá Triệu Mạnh Tùng cho biết thêm để nâng cao hiệu quả phòng ngừa, đấu tranh phòng, chống tội phạm, Bộ Công an đã làm việc với Bộ Thông tin và Truyền thông, Ngân hàng Nhà nước về việc nâng cao chất lượng định danh tài khoản điện thoại, tài khoản ngân hàng; từ đó, tìm cách làm "sạch" toàn bộ hệ thống cơ sở dữ liệu tài khoản ngân hàng, tiến tới các tài khoản ngân hàng phải được mở tài khoản chính chủ.

Hiện nay, trên Website có địa chỉ https://www.dauhieuluadao.com - dự án hợp tác giữa Google và Trung tâm Giám sát an toàn không gian mạng quốc gia - NCSC (Cục An toàn thông tin, Bộ Thông tin và Truyền thông) nhằm nâng cao nhận thức về lừa đảo trực tuyến, có cung cấp ba nguyên tắc vàng giúp ngăn chặn hành vi lừa đảo.

Nguyên tắc thức nhất là "Chậm lại." Do những kẻ lừa đảo thường tạo ra cảm giác cấp bách để làm người dùng mất cảnh giác nên hãy dành thời gian để làm rõ thêm nội dung cần chuyển tiền.

Thứ 2 là "Kiểm tra tại chỗ" để xác thực thông tin bạn đang nhận được. Nếu bạn nhận được một cuộc gọi không mong muốn, hãy tra cứu thông tin, liên hệ, xác minh lại nguồn cung cấp thông tin.

Cuối cùng là nguyên tắc: "Dừng lại! Không gửi." Không một cá nhân hoặc cơ quan nào yêu cầu thanh toán ngay tại chỗ, vì vậy, nếu bạn cảm thấy giao dịch chuyển tiền đến một tài khoản lạ là không đáng tin, hãy dừng lại vì nó có thể là lừa đảo./.